ICLR2019採択論文"Large Scale GAN Training for High Fidelity Natural Image Synthesis"のレビュー.

元論文はこちら

BigGANざっくり概要.GANsの規模を超でかくしたら超きれいな画像が作れた.

Abstract

Generative Adversarial Networks (GANs)の学習をこれまでにない規模で行った.

- GANsの学習が,問題設定の大規模化によって大きな恩恵を得ることを実証し,既存の研究と比較して2~4倍多くのパラメータ及び8倍のバッチサイズでモデルを学習した.そのような大規模な学習を安定して行うためのいくつかのテクニックも提案.

- サンプルの多様性と忠実度のトレードオフを細かく制御することを可能にする単純なサンプリング手法であるtruncation trickを提案.

- 大規模なGANs特有の学習の不安定性を発見.これは既存のGANsの学習安定化手法の適用によって緩和することができるが,完全に安定化させるためには非常に大きなコストを必要とした.

Scaling Up GANs

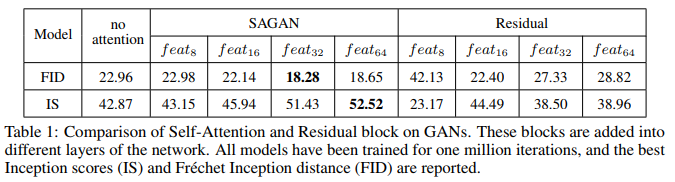

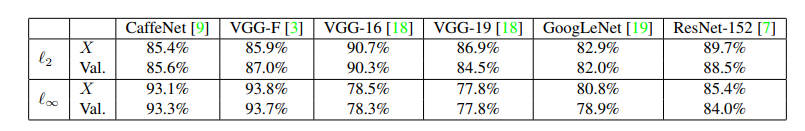

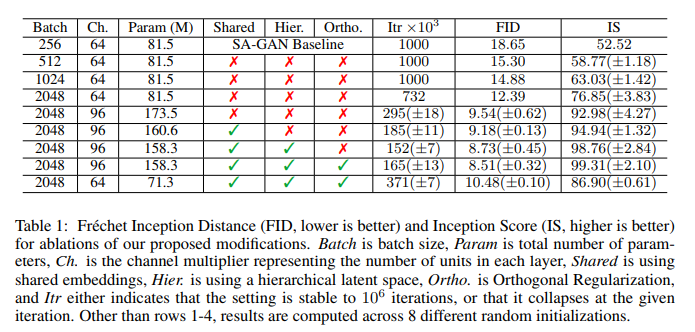

下記にベースラインの設定でバッチサイズを徐々に増やしていった場合の実験結果を示す.

単純にバッチサイズを大きく増やすことで,スコアの向上が見られる(バッチサイズを8倍にすることでInception Scoreが46%向上).

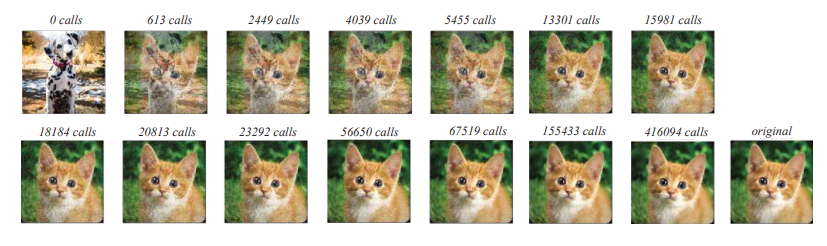

Trading Off Variety and Fidelity with The Truncation Trick

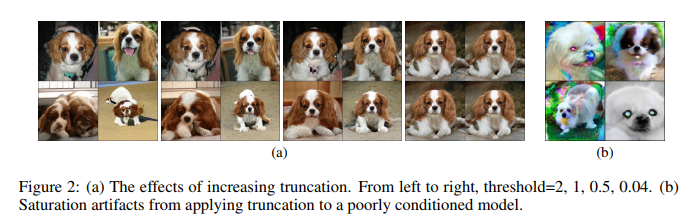

GANsは任意の潜在空間からノイズをサンプリングしてgeneratorでマッピングするが,著者らは学習時と異なる潜在分布をサンプリングに用いることで実験結果が改善したと報告.

具体的には,正規分布から入力ノイズをサンプリングする際,指定したレンジの外側をサンプリングしたときはレンジに収まるように再度サンプリングし直すというテクニックを使っている(Truncation Trick).

以下にTruncation Trickのレンジの閾値と生成画像の関係を図示する.

閾値が非常に小さいときは,同じ画像しか生成できていないことがわかる.

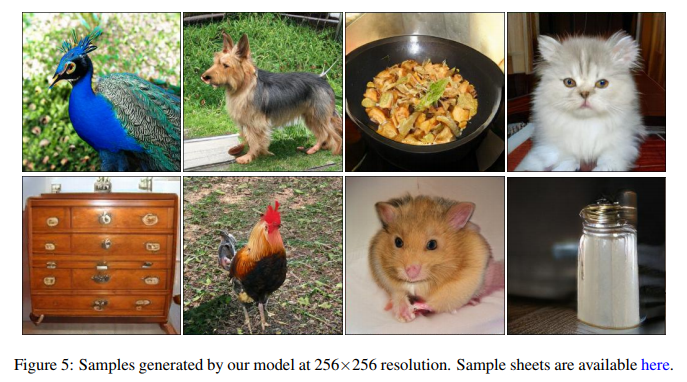

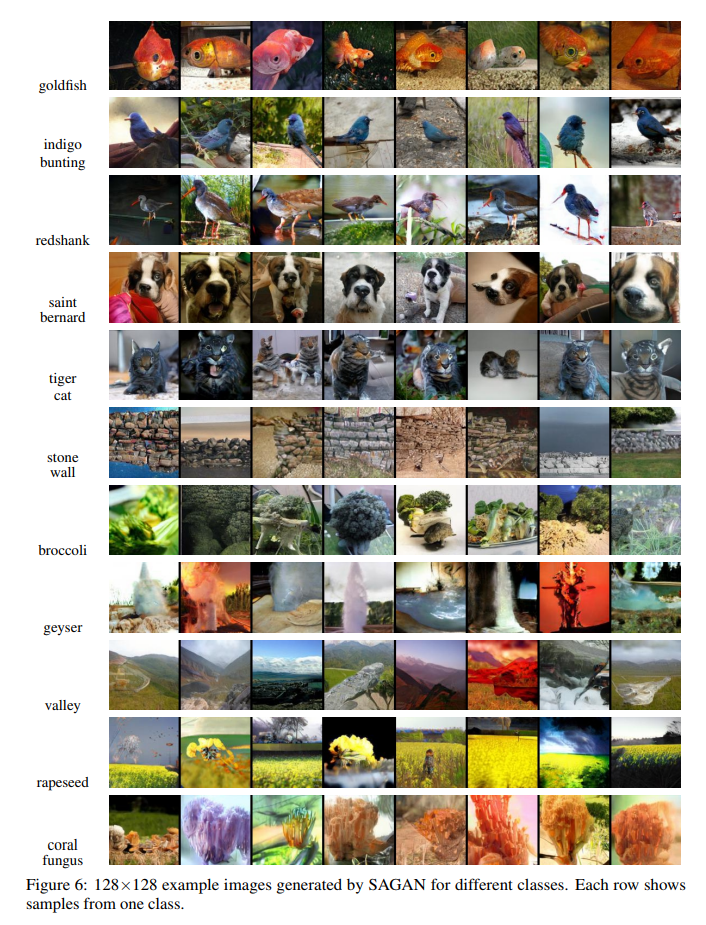

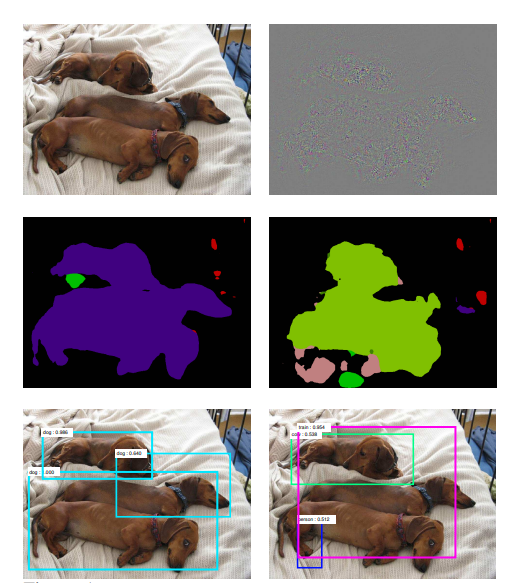

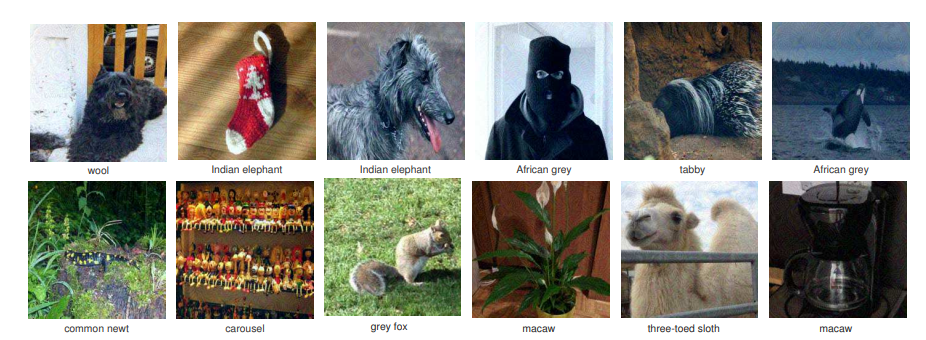

- 生成されるサンプル画像たち

- 従来よりも圧倒的にきれいな画像を作れていることがわかる.

- 論文に載り切らなかったその他のサンプル画像はこちらから入手可能