CVPR2018採択論文"Defense against Adversarial Attacks Using High-Level Representation Guided Denoiser"のレビュー.

元論文はこちら

Classifierの誤分類を誘発するAdversarial Attacksに対する防御手法の提案.

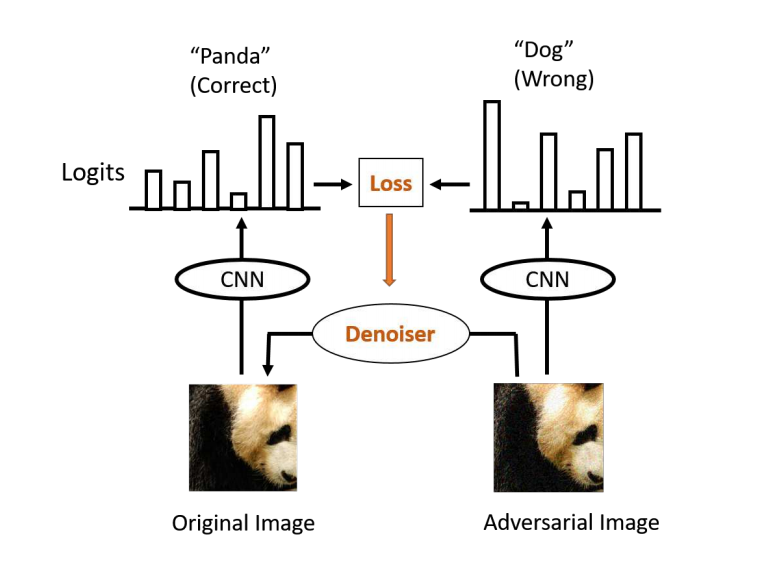

入力画像に載せられている,悪意のあるノイズ(Adversarial Perturbations)を除去するDenoiserを用意して,正しい分類結果を得ることが目的.

Abstract

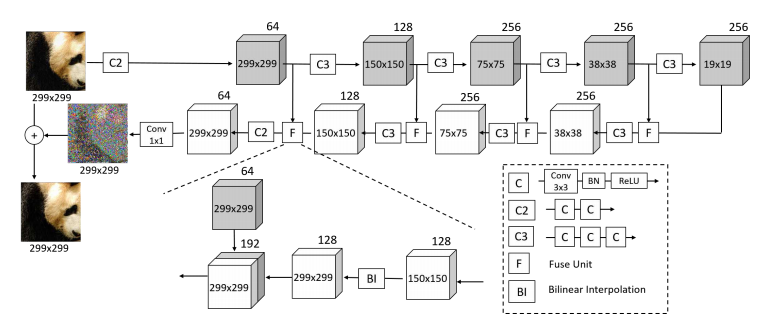

Image ClassificationタスクについてのAdversarial Attacksに対する防御手法であるhigh-level representation guided denoiser (HGD)を提案.

普通のノイズ除去モデルでは,画像内のすべてのadversarial perturbationsを除去することはできない. これを解決するため,一般的なdenoisersで用いられるpixel-level reconstruction lossではなく,もともとのサンプルとAdversarial Examplesに対する攻撃対象のモデルの出力の差を損失として扱う新しい損失関数を導入する.

High-Level Representation Guided Denoiser

ピクセルレベルのノイズ除去モデルは,以下の損失関数を最適化する.

こうしたモデルによるperturbationの除去手法では,すべてのノイズを除去することはできず,残ったperturabationsによって誤った分類が行われてしまう.

これを解決するため,以下の損失関数を導入する.

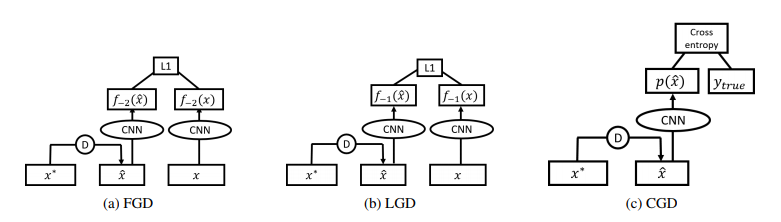

論文では,損失関数の計算で用いられるレイヤーについて,2種類の選び方を提案している.

のレイヤーを用いて特徴マップの差分を損失として用いるfeature guided denoiser (FGD)

のレイヤーを用いてモデルの分類結果の差分を損失として用いるlogits guided denoiser (LGD)